El terme algoritme prové del nom del matemàtic persa del segle IX Muhammad ibn Musà al-Warizmi. D’aleshores ençà, els algoritmes han evolucionat, mantenint, però, la seva essència: una sèrie de passos lògics per resoldre un problema.

En els darrers anys, hem assistit a l’auge de la intel·ligència artificial (IA), com és el cas del machine learning, la característica fonamental del qual és modificar i optimitzar els algoritmes sense intervenció humana explícita.

La IA implementa processos d’aprenentatge que poden ser supervisats, no supervisats o per reforç. Mitjançant patrons de dades d’entrenament etiquetades, no etiquetades, o derivades de la interacció amb un entorn, el machine learning permet crear models de classificació de dades, optimització o predicció d’interacció; o de noves dades, com és el cas –respectivament– del reconeixement del contingut d’imatges o textos, suggeriments de música o pel·lícules, o models generatius tipus ChatGPT. La qualitat i la representativitat de les dades d’entrenament, així com la finalitat d’ús, són crucials en aquest procés, perquè estan relacionades amb l’emergència de biaixos.

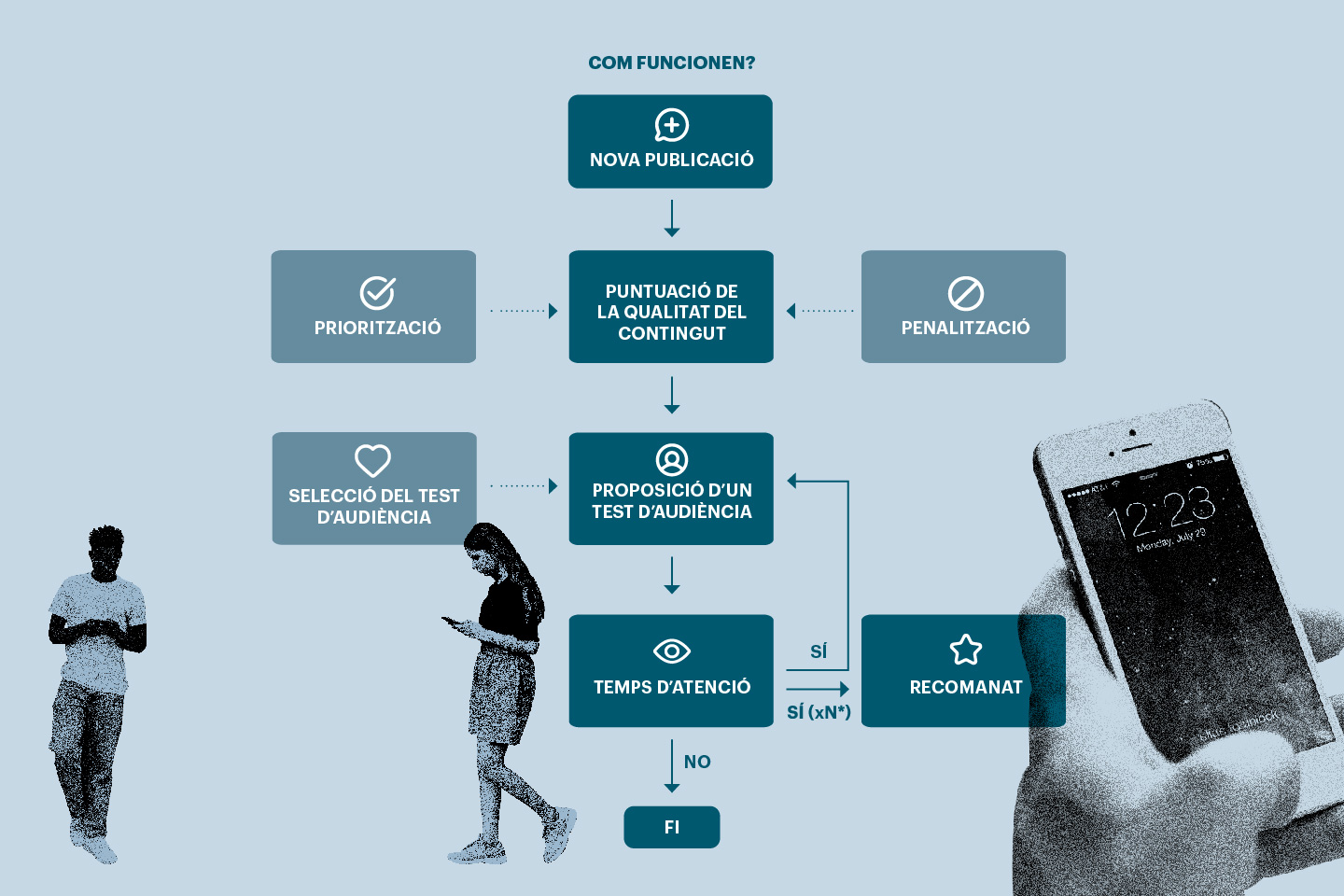

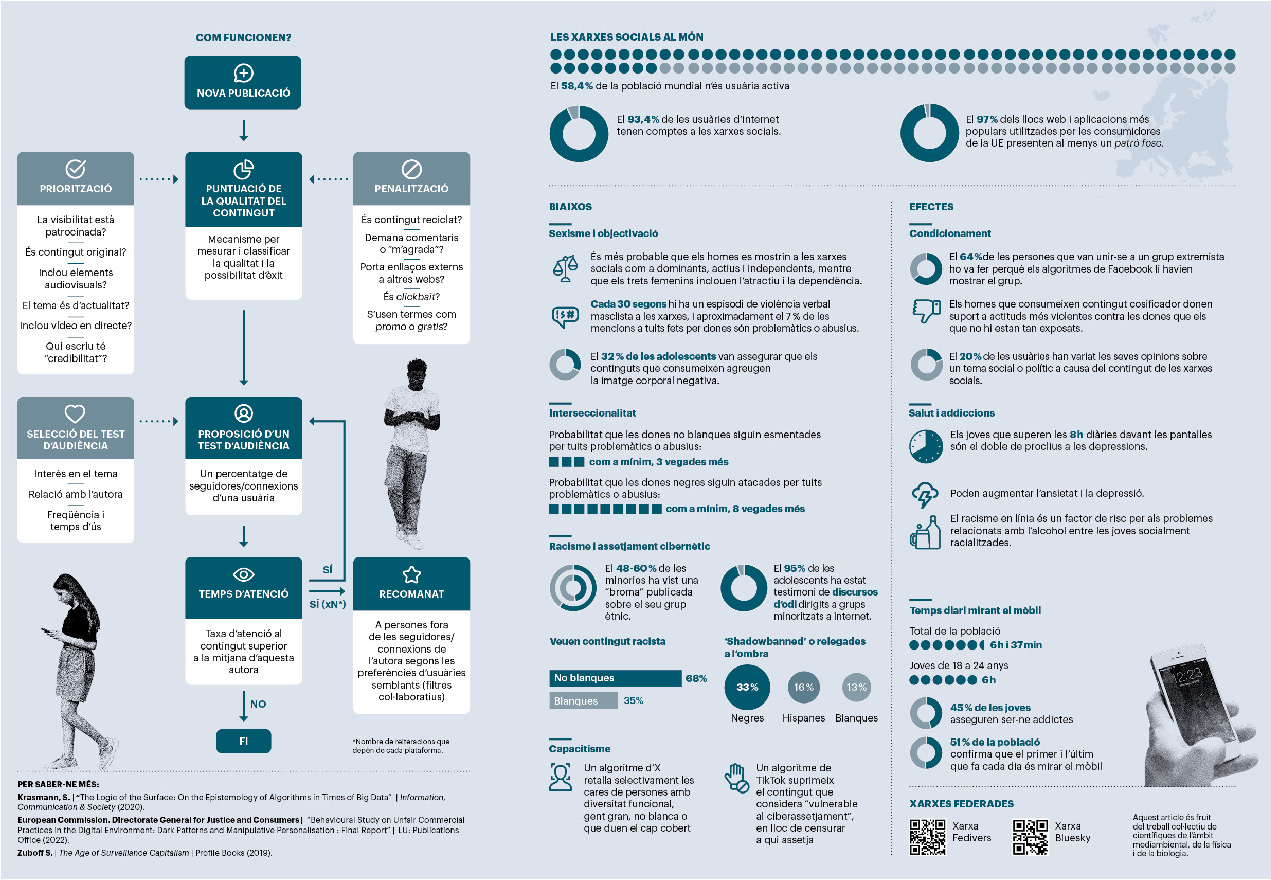

Les xarxes socials de grans empreses, com Instagram, Meta, TikTok o X, són exemples evidents d’aquest risc: els seus algoritmes estan dissenyats per maximitzar ingressos publicitaris i predir els hàbits de consum. En analitzar els comportaments de les usuàries, aquests algoritmes les classifiquen en grups d’interès i, per atraure la seva atenció i retenir-les a la xarxa, personalitzen la seva experiència recomanant i filtrant contingut segons factors de rellevància i patrocini, independentment de la seva exactitud o legitimitat. A més, hi ha algoritmes de censura o manipulació dissimulada coneguts com a patrons foscos. En aquests casos, bombolles informatives que contribueixen a la polarització d’opinions i a la reproducció i amplificació de prejudicis de gènere, perfil ètnic o classe social, que es poden materialitzar en forma de discriminació, addicció, depressió o altres efectes nocius.

Comencen, però, a sorgir altres opcions: existeixen xarxes federades, com Fedivers o Bluesky, que d’uns anys ençà es presenten com a alternatives. Aquestes iniciatives superen el problemes detectats a les grans xarxes privatives, són lliures d’anuncis i algoritmes de recomanació, i compleixen el seu objectiu original: afavorir la comunicació i la relació entre les persones.

PER SABER-NE MÉS:

Krasmann, S. | “The Logic of the Surface: On the Epistemology of Algorithms in Times of Big Data” | Information, Communication & Society (2020).

European Commission. Directorate General for Justice and Consumers | “Behavioural Study on Unfair Commercial Practices in the Digital Environment: Dark Patterns and Manipulative Personalisation : Final Report” | LU: Publications Office (2022).

Zuboff S. | The Age of Surveillance Capitalism | Profile Books (2019).

Aquest article és fruit del treball col·lectiu de científiques de l’àmbit mediambiental, de la física i de la biologia.